- 元宇宙:本站分享元宇宙相關(guān)資訊,資訊僅代表作者觀點與平臺立場無關(guān),僅供參考.

相信使用過DeepSeek-R1模型的人,對于它在給出答案之前的思考過程并不陌生,這也是包含DeepSeek-R1在內(nèi)的大型推理模型(LRM,LargeReasoningModel)備受推崇的原因之一。

然而,由蘋果公司六位研究人員組成的團隊卻對此提出了質(zhì)疑。通過讓模型解答各種謎題,研究團隊發(fā)現(xiàn)DeepSeek-R1、o3-mini和Claude-3.7-Sonnet-Thinking這幾款前沿大型推理模型在超過某一復(fù)雜度閾值之后,它們的準(zhǔn)確率會出現(xiàn)全面崩潰。

圖|相關(guān)論文的六位作者,右二為薩米·本吉奧(SamyBengio)(來源:資料圖)

X上有一名網(wǎng)友總結(jié)稱,蘋果這是當(dāng)了一次加里·馬庫斯(GaryMarcus),其實加里·馬庫斯本人也在領(lǐng)英發(fā)帖肯定了蘋果這篇論文。他寫道:“蘋果公司最新發(fā)表的關(guān)于大語言模型中‘推理’能力的論文頗具震撼力。我在一篇周末長文中解釋了其中的原因(并探討了一種可能的反對意見),以說明為何大家其實不應(yīng)感到太過驚訝。”

在加里·馬庫斯的“周末長文”里他寫道:“這篇蘋果公司的新論文進一步佐證了我本人的批評觀點:即便最新研發(fā)的所謂‘推理模型’已經(jīng)迭代超越o1版本,但在漢諾塔等經(jīng)典問題上,它們依然無法實現(xiàn)分布外可靠推理。對于那些寄希望于‘推理能力’或‘推理時計算’能讓大語言模型重回正軌、擺脫單純規(guī)模擴張卻屢屢失敗(始終無法產(chǎn)出配得上‘GPT-5’名號的技術(shù)突破)的研究者而言,這無疑是個壞消息。”

(來源:資料圖)

這些謎題具有以下特點:

(1)能夠提供對于復(fù)雜度的精細控制;

(2)避免現(xiàn)有基準(zhǔn)中常見的污染;

(3)僅需依賴明確給定的規(guī)則,強調(diào)算法化推理能力;

(4)支持基于模擬器的嚴(yán)格評估,能夠?qū)崿F(xiàn)精確的解決方案檢查和詳細的故障分析。

通過實證研究,他們揭示了關(guān)于當(dāng)前大型推理模型的幾個關(guān)鍵發(fā)現(xiàn):

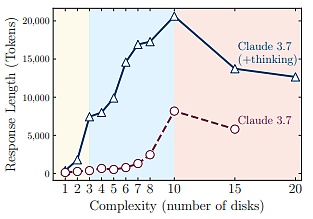

首先,盡管大型推理模型通過強化學(xué)習(xí)能夠?qū)W習(xí)復(fù)雜的自我反思機制,但它們未能為規(guī)劃任務(wù)開發(fā)出可泛化的問題解決能力,在超過一定的復(fù)雜度閾值后,性能會降至零。

其次,研究團隊在等效推理計算下對大型推理模型和標(biāo)準(zhǔn)大模型的比較揭示了三種不同的推理機制。

第一種機制是:對于更簡單、組合性較低的問題,標(biāo)準(zhǔn)大模型表現(xiàn)出更高的效率和準(zhǔn)確性。

第二種機制是:隨著問題復(fù)雜度的適度增加,大型推理模型獲得了優(yōu)勢。

第三種機制是:當(dāng)問題隨著組合深度的增加而變得復(fù)雜時,兩類模型都經(jīng)歷了徹頭徹尾的性能崩潰。

(來源:資料圖)

這表明,大型推理模型的推理能力存在一個根本性限制:其推理時間會隨著問題復(fù)雜度的增長而顯著增加。

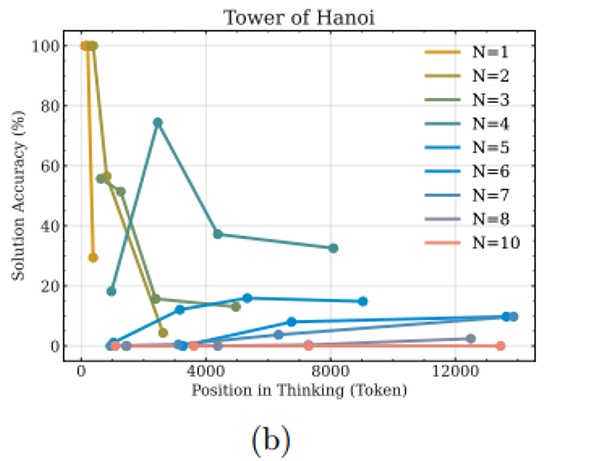

此外,通過對中間推理軌跡的分析,研究團隊發(fā)現(xiàn)了與問題復(fù)雜度相關(guān)的規(guī)律性現(xiàn)象,即在較簡單的問題中,推理模型往往能快速找到錯誤解,但卻仍會低效地繼續(xù)探索錯誤選項,這種現(xiàn)象便是人們常說的“過度思考”。

在中等復(fù)雜度的問題中,模型需要經(jīng)過對大量錯誤路徑的廣泛探索后,才能找到正確解。而超過一定的復(fù)雜度閾值,模型完全無法找到正確解。

北京郵電大學(xué)副教授白婷告訴DeepTech,跟人類思維方式相近,對于復(fù)雜問題,雖然不知道什么是正確的答案,但是很多時候知道什么是不正確的。具體而言,這跟求解空間大小有關(guān)系,簡單問題的求解空間因邏輯鏈條簡短、特征匹配度高,正確解往往天然處于思維路徑的前端,而復(fù)雜問題的解空間因涉及多維度變量耦合、邏輯層級嵌套而呈現(xiàn)指數(shù)級膨脹,求解空間龐大,客觀上表現(xiàn)為思維序列中的相對后置性。推理模型的“思維”內(nèi)部發(fā)生了什么?

研究中,大多數(shù)實驗都是在推理模型及對應(yīng)的非推理模型上進行的,例如Claude3.7Sonnet(有推理/無推理)和DeepSeek-R1/V3。研究團隊選擇這些模型是因為與OpenAI的o系列等模型不同的是,它們允許訪問思維token。

對于每個謎題實例,研究團隊生成25個樣本,并報告了每個模型的平均性能。

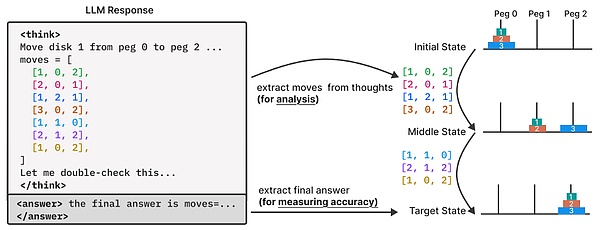

為了更深入地了解推理模型的思考過程,研究團隊對它們的推理痕跡進行了細致的分析。

期間,他們通過謎題實驗環(huán)境的構(gòu)建,實現(xiàn)了對模型最終答案之外的深度解析,從而能夠?qū)ζ渖傻耐评碥壽E(即“思考過程”)進行更精細的觀測與分析。

具體來說,他們借助謎題模擬器,對模型思維過程中探索的中間解進行了提取與分析。

隨后,他們考察了這些中解的模式和特征、相對于推理過程中順序位置的正確性,以及這些模式如何隨著問題復(fù)雜度的增加而演變。

對于這一分析,研究團隊重點關(guān)注了Claude3.7Sonnet推理模型在謎題組實驗中產(chǎn)生的推理痕跡。

對于痕跡中確定的每個中間解法,研究團隊記錄了以下內(nèi)容:(1)其在推理軌跡中的相對位置(按總思維長度歸一化),(2)經(jīng)研究團隊的謎題模擬器驗證的其正確性,(3)相應(yīng)問題的復(fù)雜度。

這使得研究團隊能夠描述整個推理過程中解決方案形成的進展和準(zhǔn)確性。

然而,對于更復(fù)雜的問題,這一趨勢會發(fā)生變化——解決方案的準(zhǔn)確性會隨著思考的推進而提高,直至達到某個閾值。超過這個復(fù)雜度閾值,在“崩潰模式”下,模型的準(zhǔn)確率為零。

白婷告訴DeepTech,模型在復(fù)雜問題中需要多次推理,在一直沒有正確解的前提下,模型推理機制中有可能采用了多次迭代推理生成效率優(yōu)化策略,或許是防止迭代過多的一種資源保護策略。因此,本次論文中的發(fā)現(xiàn)需要從模型實現(xiàn)層面去進行細致的分析和驗證。

白婷指出,大模型的推理過程本質(zhì)上是記憶模式的調(diào)用也是有可能的。對于DeepSeek-R1、o3-mini這類模型,其表現(xiàn)高度依賴訓(xùn)練數(shù)據(jù)中記憶模式的覆蓋范圍,當(dāng)問題復(fù)雜度突破記憶模式的覆蓋閾值(如本次蘋果研究團隊設(shè)計的可控謎題環(huán)境),模型便陷入“零準(zhǔn)確率”狀態(tài)。

雖然本次謎題環(huán)境允許對問題復(fù)雜度進行細粒度控制的受控實驗,但它們僅代表推理任務(wù)的一小部分,可能無法捕捉到現(xiàn)實世界或知識密集型推理問題的多樣性。

需要指出的是,本研究主要基于黑箱API訪問封閉的前沿大推理模型,這一限制使研究團隊無法分析其內(nèi)部狀態(tài)或架構(gòu)組件。

此外,使用確定性謎題模擬器時,研究團隊假設(shè)推理可以一步一步地得到完美驗證。然而,在結(jié)構(gòu)化程度較低的領(lǐng)域,這種精確的驗證可能難以實現(xiàn),從而限制了該分析方法向更廣泛推理場景的遷移。

總的來說,研究團隊通過可控的解謎環(huán)境,從問題復(fù)雜度的角度考察了前沿大型推理模型。這一成果揭示了當(dāng)前模型的局限性:即盡管它們擁有復(fù)雜的自我反思機制,但這些模型在超過特定復(fù)雜度閾值后,仍然無法發(fā)展出可泛化的推理能力。研究團隊認(rèn)為,本次成果或許能為研究這些模型的推理能力鋪平道路。

免責(zé)聲明:蘋果新論文分析DeepSeek-R1遇到復(fù)雜度閾值后準(zhǔn)確率崩潰問題文章轉(zhuǎn)發(fā)自互聯(lián)網(wǎng),版權(quán)歸其所有。

文章內(nèi)容不代表本站立場和任何投資暗示。加密貨幣市場極其波動,風(fēng)險很高,可能不適合所有投資者。在投資加密貨幣之前,請確保自己充分了解市場和投資的風(fēng)險,并考慮自己的財務(wù)狀況和風(fēng)險承受能力。此外,請遵循您所在國家的法律法規(guī),以及遵守交易所和錢包提供商的規(guī)定。對于任何因使用加密貨幣所造成的投資損失或其他損失,本站不承擔(dān)任何責(zé)任。

Copyright © 2021.Company 元宇宙YITB.COM All rights reserved.元宇宙YITB.COM